Z Skrypty dla studentów Ekonofizyki UPGOW

Spis treści |

PROCESY STOCHASTYCZNE

Procesy stochastyczne

Nim podamy formalną definicję procesu stochastycznego, rozważmy przykład który przybliży nam to pojęcie.

Przykład

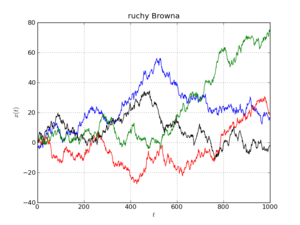

Cząstka Browna wykonuje ruch losowy. Można sobie wyobrazić, że przeprowadzamy doświadczenie z kolorową cząstką Browna w wodzie i śledzimy jej ruch w przestrzeni. Analizujemy ruch tylko w jednym kierunku poziomym, który oznaczymy jako oś X (rzutujemy ruch trójwymiarowy na jedną oś). Przedstawimy jednowymiarowy ruch takiej cząstki na wykresie. Oś pionowa przedstawia położenie cząstki, oś pozioma - czas. Położenie cząstki w chwili t oznaczymy jako \(\xi(t)\). Możemy tego typu doświadczenie powtarzać wielokrotnie (teoretycznie: nieskończenie wiele razy). W kolejnych doświadczeniach w chwili \(t=0\) cząstka może znajdować się w tym samym miejscu lub nie, to nie ma większego znaczenia. Załóżmy, że znajduje się w tym samym miejscu, nazwanym umownie \(x=0\), czyli warunek początkowy możemy zapisać w postaci \(\xi(0)=0\). Na rysunku przedstawione są wyniki czterech doświadczeń. Przedstawiamy cztery trajektorie cząstki Browna. W kolejnych doświadczeniach otrzymujemy inną trajektorię czastki. Gdybyśmy przeprowadzali coraz to więcej doświadczeń, trajektorie pokrywały by coraz to większą część płaszczyzny.

Chcemy zbadać własności wyników opisanego powyżej eksperymentu, w szczególności własności ruch cząstki Browna w określonym przedziale czasowym \((0, T], \; T > 0\). Przedstawione na rysunku cztery trajektorie to możliwe realizacje tego procesu. Ustalmy chwilę czasu, np. \(t=400\). Linia pionowa \(t=400\) na rysunku przecina trajektorie w czterech punktach. Te cztery punkty \(\xi(t=400)\) można potraktować jako możliwe wartości zmiennej losowej, którą oznaczymy \(\xi_{400}\). Jeżeli mamy tysiące takich trajektorii, to można standardowymi metodami statystyki obliczyc wartość średnią zmiennej losowej \(\xi_{400}\), jej wariancję, momenty statystyczne wyższego rzędu, itd. Możemy wybrać inną chwilę czasu, np. \(t=800\). Otrzymamy inną zmienną losową, którą oznaczymy \(\xi_{800}\). Możemy tak samo jak dla zmiennej losowej \(\xi_{400} \) obliczyć charakterystyki probabilistyczne zmiennej losowej \(\xi_{800} \). Możemy wybrać każdą inną chwilę czasu \(t=t_k\) otrzymując zmienną losową \(\xi_k\). Czytelnik domyśla się, że otrzymamy coś, co poprzednio nazwaliśmy wektorem losowym

Ale wektor ten ma nieskończenie wiele składowych, ponieważ czas \(t\) zmienia się w sposób ciągły i wskażnik \(k\) przyjmuje nieskończenie wiele wartości w przedziale \((0, T], \; T > 0\). Zagadnienie staje się wyjątkowo skomplikowane, ponieważ musimy badać wektor losowy o nieskończenie wielu składowych. Z rozdziału 4.8 wiemy, że aby taki wektor losowy w pełni scharakteryzować, powinniśmy wyznaczyć jego rozkłady prawdopodobieństwa

\(P_[[:Szablon:\mathbf \xi]](B_1, B_2, ..., B_n) = Pr(\xi_1 \in B_1, \xi_2 \in B_2, \ ..., \xi_n \in B_n) \)

\(= P(\{\omega: \xi_1(\omega) \in B_1, \xi_2(\omega) \in B_2, \ ..., \xi_n(\omega) \in B_n)\)

lub dystrybuanty

\(F(x_1, x_2, ..., x_n) = Pr(\xi_1 \le x_1, \xi_2 \le x_2, ..., \xi_n \le x_n) \)

lub gęstości rozkładu prawdopodobieństwa

\( p(x_1, x_2, ..., x_n) = \frac{ \partial^n F(x_1, x_2, ..., x_n)}{\partial x_1 \partial x_2 ... \partial x_n} \)

Ale teraz n może zmieniać się od \(n=1\) to nieskończoności, \(n = 1, 2, 3, \dots \).

Zapis w Równaniu (1) oznacza zbór możliwych położeń cząstki Browna w różnych chwilach czasu indeksowanego przez wskaźnik \(k\). Bardziej precyzyjny zapis ma formę

Jest to przykład procesu stochastycznego. Należy uwypuklić dwa elementy tego procesu:

(1) dla ustalonej chwili czasu \(t=t_k\), wielkość \(\xi(\omega, t_k) = \xi_k(\omega)\) jest zmienna losową, czyli są to możliwe położenia cząstki w tej samej chwili czasu ale dla wielu doświadczeń, czyli różnych \(\omega \in \Omega\); wielkości \(\xi(\omega_1, 5), \; \xi(\omega_2, 5), \; \xi(\omega_3, 5), \; \xi(\omega_4, 5)\) to położenia cząstki w chwili \(t=5\) dla doświadczenia pierwszego, drugiego, trzeciego i czwartego.

(2) jedna trajektoria cząstki to jedna realizacja procesu stochastycznego, to znaczy jest to funkcja czasu dla ustalonego \(\omega \in \Omega\), czyli \(\xi(\omega_1, t)\) są to możliwe położenia cząstki dla pierwszego doświadczenia \((\omega = \omega_1)\) ale różnych chwil czasu.

Różne doświadczenia są indeksoweane przez \(\omega \in \Omega\), różne chwile czasu - przez \(t \in(0, T]\). W ogólności położenie jest indeksowane przez oba wskaźniki czyli \(\xi = \xi(\omega, t)\). Często opuszczany jest wskaźnik \(\omega\) (zwłaszcza przez nie-matematyków) i używa się uproszczonej notacji \(\xi(t)\). Po tym przykładzie możemy podać formalną definicję procesu stochastycznego.

DEFINICJA

Niech \((\Omega, \mathcal F, P)\) będzie przestrzenia probabilistyczną, \({\mathcal T}\) - zbiorem liczb rzeczywistych lub podzbiorem tego zbioru. Zbiór \({\mathcal T}\) będziemy interpretowali jako czas. Przez \(t\) oznaczymy element zbioru \({\mathcal T}\). Niech \((X, \mathcal B)\) będzie przestrzenia fazową. Funkcję

\(\xi: \Omega \times {\mathcal T} \to X\)

nazywamy procesem stochastycznym jeżeli dla każdego \(t\) oraz dla każdej liczby rzeczywistej \(x\) zbiór

\(\{\omega: \xi(\omega, t) \le x\} \in \mathcal F\)

jest zdarzeniem w przestrzeni probabilistycznej \(\Omega\).

Funkcja \(\xi = \xi(\omega, t) \) jest funkcją dwóch zmiennych: \(\omega\) oraz \(t\). Dla każdego ustalonego \(t\) funkcja \(\xi = \xi(\omega, t) \) rozważana jako funkcja argumentu \(\omega\) jest zmienną losową. Dla ustalonego zdarzenia elementarnego \(\omega\) funkcja ta nie jest losowa i nazywa sie realizacją procesu stochastycznego. Zatem proces stochastyczny można traktować jako rodzinę zmiennych losowych indeksowanych "czasem" \(t \in\mathcal T\) albo rodzinę realizacji zależną od parametru \(\omega \in \Omega\) .

UWAGI

1. Często przestrzeń fazową \(X\) nazywa sie przestrzenią stanów. Jeżeli \(\xi(\omega, t) =x\) mówimy, że układ jest w stanie \(x\in X\).

2. Jeżeli \(X\) jest zbiorem liczb rzeczywistych i \(\xi(\omega, t)\) może przyjmować dowolne wartości z tego zbioru, to proces stochastyczny nazywamy typu ciągłego (przez analogię do zmiennej losowej ciągłej).

3. Jeżeli \(X\) jest zbiorem liczb całkowitych lub naturalnych i \(\xi(\omega, t)\) przyjmuje wartości z tego zbioru, to proces stochastyczny nazywamy typu dyskretnego (przez analogię do zmiennej losowej dyskretnej).

4. Jeżeli "czas" jest dyskretny (indeksowany przez liczby całkowite lub naturalne) oraz \(X=R\), to proces stochastyczny nazywamy ciągiem losowym.

5. Jeżeli "czas" jest dyskretny (indeksowany przez liczby całkowite lub naturalne) oraz \(X\) jest zbiorem liczb całkowitych lub naturalnych, to proces stochastyczny nazywamy łańcuchem losowym.

Charakterystyki procesu stochastycznego

Analizując ruch Browna jako przykład procesu stochastycznego zauważyliśmy, że ten proces jest zbiorem nieskończenie wielu zmiennych losowych. Pamiętamy, że dla \(n\)-zmiennych losowych powinniśmy wyznaczyć łączny rozkład prawdopodobieństwa, czyli \(n\)-wymiarowy rozkład. W przypadku zbioru nieskończenie wielu zmienny losowych nie możemy oczekiwać, że określimy nieskończenie wymiarowy rozkład prawdopodobieństwa. Możemy starać się wyznaczyć rozkłady skończenie wymiarowe. Z praktycznego punktu widzenia, kilku-wymiarowe rozkłady są wystarczające. I tak zdefiniujemy rozkład jednowymiarowy procesu stochastycznego \(\xi(t)\):

CHARAKTERYSTYKI JEDNO-WYMIAROWE

1. Jednowymiarowa dystrybuanta

\(F(x, t) = Pr\{\xi(t) \le x\}\)

2. Jednowymiarowa gęstośc prawdopodobieństwa

\(p(x, t) = \frac{\partial F(x, t)}{\partial x}\)

3. prawdopodobieństwo tego, że w chwili \(t\) proces \(\xi(t)\) przyjmuje wartości z przedziału \((x_1, x_2]\) wynosi

\(Pr\{x_1 < \xi(t) \le x_2\} = Pr\{ \xi(t) \in (x_1, x_2]\} = \int_{x_1}^{x_2} p(x, t) \; dx\)

4. Warunek unormowania

\(\int_{-\infty}^{\infty} p(x, t) \; dx = 1 \)

5. Wartość średnia procesu \(\xi(t)\) w chwili \(t\) wynosi

\(m(t) = \langle \xi(t)\rangle = \int_{-\infty}^{\infty} x\; p(x, t) \; dx \)

6. Moment statystyczny k-tego rzędu procesu \(\xi(t)\) w chwili \(t\) wynosi

\(\langle \xi^k(t)\rangle = \int_{-\infty}^{\infty} x^k \; p(x, t) \; dx \)

7. Fluktuacje procesu \(\xi(t)\) w chwili \(t\) opisywane są przez moment centralny 2-go rzędu:

\(\sigma^2(t) = \langle [\xi(t) - m(t)]^2\rangle = \langle [\xi(t) - \langle \xi(t)\rangle]^2\rangle = \langle \xi^2(t)\rangle - \langle \xi(t)\rangle^2 \)

Wielkość tę nazywamy też średnio-kwadratowym odchyleniem, wariancją lub średnio-kwadratowym przemieszczeniem (jeżeli dotyczy to dynamiki czastek).

8. Wartość średnia dowolnej funkcji \(g(\xi(t)) \) procesu \(\xi(t)\) w chwili \(t\) wynosi

\(\langle g(\xi(t)) \rangle = \int_{-\infty}^{\infty} g(x) \; p(x, t) \; dx \)

9. Jedno-wymiarowa funkcja charakterystyczna

\(C(\omega, t) = \langle e^{i\omega \xi(t)} \rangle = \int_{-\infty}^{\infty} e^{i\omega x} \; p(x, t) \; dx \)

Uwaga: tutaj \(\omega \in R\) jest dowolną liczbą rzeczywistą i nie ma nic wspólnego ze zdarzeniem elementarnym \(\omega \in \Omega\). Ponieważ historycznie zakorzeniło się oznaczenie dla funkcji charakterystycznej z argumentem \(\omega\), więc mamy jeszcze jeden powóod, aby używać uproszczonego zapisu \(\xi(\omega, t) = \xi(t)\) dla procesów stochastycznych.

CHARAKTERYSTYKI DWU-WYMIAROWE

1. Dwuwymiarowa dystrybuanta

\(F(x_2, t_2; x_1, t_1) = Pr\{\xi(t_2) \le x_2; \xi(t_1) \le x_1\}\)

2. dwuwymiarowa gęstośc prawdopodobieństwa

\(p(x_2, t_2; x_1, t_1) = \frac{\partial^2 F(x_2, t_2; x_1, t_1)}{\partial x_2 \partial x_1}\)

3. prawdopodobieństwo tego, że w chwili \(t_2\) proces \(\xi(t)\) przyjmuje wartości z przedziału \((a, b]\) oraz w chwili \(t_1\) proces \(\xi(t)\) przyjmuje wartości z przedziału \((c, d]\) wynosi

\(Pr\{a < \xi(t_2) \le b; c < \xi(t_1) \le d\} = Pr\{ \xi(t_2) \in (a, b]; \xi(t_1) \in (c,d] \)

\( =\int_{a}^{b} \int_{c}^{d} p(x_2, t_2; x_1, t_1) \; dx_2 \; dx_1 =\int_{a}^{b} dx_2 \int_{c}^{d} dx_1 \; p(x_2, t_2; x_1, t_1) \)

UWAGA: Czasami będziemy używali zapisu jak powyżej, aby uwidocznić w jakich granicach całkujemy po jakich zmiennych.

4. Warunek unormowania

\(\int_{-\infty}^{\infty} \int_{-\infty}^{\infty} p(x_2, t_2; x_1, t_1) dx_2 \; dx_1= 1 \)

5. Funkcja korelacji (funkcja korelacyjna) procesu stochastycznego

\(R(t_2, t_1) =\langle \xi(t_2)\xi(t_1)\rangle = \int_{-\infty}^{\infty} \int_{-\infty}^{\infty} \; x_2 \; x_1 \;p(x_2, t_2; x_1, t_1)\; dx_2\; dx_1 \)

Jeżeli

\(R(t_2, t_1) =\langle \xi(t_2)\xi(t_1)\rangle = \langle \xi(t_2)\rangle \; \langle\xi(t_1)\rangle \; \;\ \; dla \; \;\ t_2 \ne t_1\)

to proces nazywamy nieskorelowanym.

6. Funkcja kowariancji (kowariancja) procesu stochastycznego

\(C(t_2, t_1) =\langle [\xi(t_2) - m(t_2)][\xi(t_1) -m(t_1)]\rangle = \langle \xi(t_2)\xi(t_1)\rangle -m(t_2) m(t_1)\)

\( = R(t_2, t_1)-m(t_2) m(t_1) \,\)

7. Wartość średnia dowolnej funkcji \(g \left(\xi(t_2, \xi(t_1)\right) \) procesu w różnych chwilach czasowych

\(\langle g(\xi(t_2), \xi(t_1) ) \rangle = \int_{-\infty}^{\infty} \int_{-\infty}^{\infty} g(x_2, x_1) \;p(x_2, t_2; x_1, t_1)\; dx_2\; dx_1 \)

8. Dwu-wymiarowa funkcja charakterystyczna

\(C(\omega_2, t_2; \omega_1, t_1) = \langle e^{i[\omega_1 \xi(t_1) + \omega_2 \xi(t_2)]} \rangle = \int_{-\infty}^{\infty} \int_{-\infty}^{\infty} e^{i(\omega_1 x_1 + \omega_2 x_2)} \;p(x_2, t_2; x_1, t_1)\; dx_2\; dx_1 \)

Oczywiście jeżeli ktoś woli pisać wskaźniki (2, 1) w odwrotnej kolejności (1, 2) to nie jest to zabronione, ale czasami ich uporządkowanie jest ważne, tak jak np. w punkcie 6.

Dodatkowe definicje

1. Przyrosty procesy stochastycznego \(\xi(t)\)

\(\Delta \xi(t_i) = \xi(t_i + \Delta t) - \xi(t_i) \,\)

\( d\xi(t) = \xi(t + dt) - \xi(t) \,\)

2. Proces stochastyczny \(\xi(t)\) nazywamy procesem o przyrostach niezależnych jeżeli dla dowolnych nieprzekrywających się przedziałów

\(t_0 < t_1 < \dots < t_n\)

zmienne losowe

\(\xi(t_0), \; \xi(t_1)-\xi(t_0), \; \xi(t_2)- \xi(t_1), \; \dots, \; \xi(t_n) - \xi(t_{n-1})\)

są niezależne.

Udowodnienie, że dany proces stochastyczny ma przyrosty niezależne jest często trudnym problemem. Czasami intuicyjne rozważania są pomocne w tej kwestii.

3. Procesy stacjonarne

(a) stacjonarność w węższym sensie

Jeżeli proces \(\xi(t)\) oraz proces \(\xi(t+\epsilon) \) mają te same n-wymiarowe rozkłady prawdopodobieństwa

\(p(x_n, t_n; \;x_{n-1}, t_{n-1}; \dots ; x_2, t_2; \;x_1, t_1) \)

\( = p(x_n, t_n +\epsilon; \;x_{n-1}, t_{n-1}+\epsilon; \dots ; x_2, t_2+\epsilon; \;x_1, t_1+\epsilon)\)

dla dowolnego \(n\) i dowolnego \(\epsilon\).

W szczególności zachodzi

dla n=1:

\(p(x, t) = p(x, t+\epsilon)\;\)

Stąd wynika że 1-wymiarowa gęstość prawdopodobieństwa \(p(x, t) = p(x)\) nie zależy od czasu oraz wartość średnia procesu \(m(t)=\langle \xi(y) \rangle = m \;\) nie zależy od czasu.

dla n=2:

\(p(x_2, t_2; x_1, t_1) = p(x_2, t_2+\epsilon; x_1, t_1+\epsilon)\;\)

Stąd wynika że 2-wymiarowa gęstość prawdopodobieństwa

\(p(x_2, t_2; x_1, t_1)= p(x_2, x_1; t_2- t_1)\;\)

zależy od różnicy czasów \(t_2\) i \(t_1\). To z kolei implikuje że funkcja korelacji

\(R(t_2, t_1) =\langle \xi(t_2)\xi(t_1)\rangle = \int_{-\infty}^{\infty} \int_{-\infty}^{\infty} \; x_2 \; x_1 \;p(x_2, x_1; t_2- t_1)\; dx_2\; dx_1 = R(t_2 -t_1) \)

oraz

\(\langle \xi(t + \tau)\xi(t)\rangle = R(\tau)\)

(b) stacjonarność w szerszym sensie

Jeżeli wartość średnia procesu

\(m(t)=\langle \xi(y) \rangle = m \)

nie zależy od czasu oraz funkcja korelacji

\(\langle \xi(t + \tau)\xi(t)\rangle = R(\tau)\)

zależy od różnicy czasów \(t+ \tau\) i \(t\), wówczas proces stochastyczny \(\xi(t)\) nazywamy stacjonarnym w szerszym sensie. Oczywiście jeżeli \(\xi(t)\) jest stacjonarny w węższym sensie to jest także stacjonarny w szerszym sensie. Odwrotnie nie musi zachodzić.

4. Spektrum (widmo) mocy stacjonarnego procesu stochastycznego

\(S(\omega) = \int_{-\infty}^{\infty} e^{i\omega \tau} \; R(\tau) \; d\tau \)

Jest to transformata Fouriera funkcji korelacyjnej. Dla procesów niestacjonarnych pojęcie to nie jest dobrze zdefiniowane.

Z optyki wiemy, że kolor światła zależy od częstości promieniowania elektromagnetycznego. Kolor zielony czy fioletowy mają różne widma, ale krzywe widmowe zwykle są rozmyte i mają maksima w otoczeniu częstości odpowiadającej kolorowi zielonemu czy fioletowemu. Widmo światła białego nie ma wyróżnionych częstości. Inaczej mówiąc widmo to nie zależy od częstości. Przez analogię, proces stochastyczny którego widmo mocy nie zależy od częstości nazywamy białym szumem. Z powyższego wzoru można wnioskować, że jeżeli funkcja korelacyjna ma postać

\(\langle \xi(t + \tau)\xi(t)\rangle = R(\tau)= D \delta(\tau)\)

gdzie \(\delta(\tau)\) jest deltą Diraca, to widmo mocy nie zależy od częstości. Jeżeli wartośc średnia \(m(t) = m \) stacjonarnego procesu stochastycznego nie zeruje się, to zamiast funkcji korelacyjnej stosuje sie funkcję kowariancji i wówczas

\( C(t_2, t_1)= C(t_2, t_1) =\langle [\xi(t_2)-m][\xi(t_1)-m]\rangle = D \delta(t_2- t_1)\)

Z własności delty Diraca wiemy, że jeżeli \(t_2\ne t_1\) to \(\delta(t_2- t_1) =0\) czyli

\(C(t_2, t_1) = \langle \xi(t_2)\xi(t_1)\rangle -m^2 = \langle \xi(t_2)\xi(t_1)\rangle - \langle \xi(t_2)\rangle \; \langle\xi(t_1)\rangle =0 \; \; dla \; \; t_2\ne t_1\)

czyli

\(\langle \xi(t_2)\xi(t_1)\rangle = \langle \xi(t_2)\rangle \; \langle\xi(t_1)\rangle \; \; dla \; \; t_2\ne t_1\)

Stąd wnioskujemy, że biały szum jest nieskorelowanym procesem stochastycznym. Czasami mówi się, że jest to \(\delta\)-skorelowany szum. Nie oznacza to, że funkcja kowariancji każdego nieskorelowanego procesu jest dana przez deltę Diraca.

Charakterystyki pochodnej procesu stochastycznego

W teorii procesów stochastcznych istnieje kilka definicji ciągłości. Jest ciągłość prawie wszędzie (prawie na pewno); jest ciągłość według miary (w sensie prawdopodobieństwa) i jest ciągłość średnio-kwadratowa (w sensie średnio-kwadratowym). To ostatnie pojęcie jest dobrze znane fizykom z kursu mechaniki kwantowej.

DEFINICJA 1.

Proces stochastyczny \(\xi(t) \) jest ciągły średnio-kwadratowo w punkcie \(t_0\) jeżeli

\[\mbox{lim}_{h \to 0} \langle [\xi(t_0+h) - \xi(t_0)]^2 \rangle =0 \;\]

Taką definicję można stosować dla procesów stochastcznych dla których istnieje moment statystyczny drugiego rzedu, czyli

\[\langle \xi^2(t) \rangle < \infty\; \]

Oczywiście proces stochastyczny \(\xi(t) \) jest ciągły gdy jest ciągły w każdym punkcie \(t\).

Podobnie mozna zdefiniować pojęcie pochodnej procesu stochastycznego.

- DEFINICJA 2.

Proces stochastyczny \(\xi(t) \) jest różniczkowalny średnio-kwadratowo w punkcie \(t_0\) jeżeli istnieje taki proces stochastyczny \(\eta(t)\) że

\[\mbox{lim}_{h \to 0} \langle \left[ \frac{\xi(t_0+h) - \xi(t_0)}{h} - \eta(t_0)\right]^2 \rangle =0 \;\]

Proces \(\eta (t) \,\) nazywa się pochodną procesu \(\xi(t)\;\) i często oznacza jako

\[\eta(t) = \frac{d\xi(t)}{dt} = {\dot \xi}(t) \;\]

Podamy dwie ważne charakterystyki pochodnej procesu stochastycznego.

-

- Wartość średnia pochodnej procesu stochastycznego

Jeżeli

- \(\langle\xi(t)\rangle = m(t)\)

to

Czyli wartość średnia pochodnej procesu stochastycznego jest równa pochodnej wartości średniej tego procesu.

DOWÓD

\(\langle {\dot \xi(t)} \rangle = \lim_{h\to 0} \langle \frac{\xi(t+h) - \xi(t)}{h}\rangle \)

\( = \lim_{h\to 0} \frac{1}{h} [\langle \xi(t+h)\rangle - \langle \xi(t)\rangle] = \lim_{h\to 0} \frac{1}{h} [m(t+h) - m(t)] = \frac{d m(t)}{dt} \)

Skorzystaliśmy tu z własności wartości średniej

\[\langle \alpha \xi_1(t) + \beta \xi_2(t) \rangle = \alpha \langle \xi_1(t)\rangle + \beta \langle \xi_2(t) \rangle \]

dla dowlolnych liczb \(\alpha\) i \(\beta\).

-

- Funkcja korelacyjna pochodnej procesu stochastycznego

Jeżeli

- \(\langle\xi(t_2)\;\xi(t_1)\rangle = R(t_2, t_1)\)

to

Czyli funkcja korelacyjna pochodnej procesu stochastycznego jest równa pochodnej mieszanej drugiego rzędu funkcji korelacyjnej procesu stochastycznego.

DOWÓD

\(\langle {\dot \xi(t_2)}{\dot \xi(t_1)} \rangle = \lim_{h\to 0 \ \epsilon \to 0} \; \; \langle \frac{\xi(t_2+h) - \xi(t_2)}{h} \cdot \frac{\xi(t_1+\epsilon) - \xi(t_1)}{\epsilon} \rangle \)

\( = \lim_{h\to 0 \ \epsilon \to 0} \; \; \frac{1}{ h \epsilon} \langle [\xi(t_2+h) - \xi(t_2)] \cdot [\xi(t_1+\epsilon) - \xi(t_1)] \rangle \)

\( = \lim_{h\to 0 \ \epsilon \to 0} \; \; \frac{1}{ h \epsilon} [ \langle \xi(t_2+h) \xi(t_1+\epsilon)\rangle - \langle \xi(t_2+h) \xi(t_1)\rangle \)

\[ \; \; \; - \langle\xi(t_2) \xi(t_1+\epsilon) \rangle + \langle \xi(t_2) \xi(t_1)] \rangle ]\]

\( = \lim_{h\to 0 \ \epsilon \to 0} \; \; \frac{1}{ h \epsilon} \left\{ R(t_2+h, t_1+\epsilon) - R(t_2+h, t_1) - R(t_2, t_1+\epsilon) + R(t_2, t_1) \right\} \)

\( = \frac{\partial^2 R(t_2, t_1)}{\partial t_2 \,\partial t_1}\)

Ostatnia linia jest definicją pochodnej mieszanej drugiego rzędu funkcji \(R(t_2, t_1)\). Można wykazać, że proces stochastyczny \(\xi(t)\) jest różniczkowalny średnio-kwadratowo w punkcie \(t\) wtedy i tylko wtedy gdy istnieje pochodna mieszana

- \(\frac{\partial^2 R(t_2, t_1)}{\partial t_2 \,\partial t_1}\)

dla \(t_2=t\) i \(t_1=t\). Istnienie pochodnej oznacza to, że pochodna przyjmuje skończone wartości dla wszystkich \(t_1=t_2=t\).